سیستم جدید هوشمصنوعی سیگنالهای مغز را با دقت ٪۹۷ به متن تبدیل میکند

تشخیص گفتار تقریباً شبیه به یک بازی کودکانه است: سیستمهای هوشمصنوعی (AI) که میتوانند فعالیت مغز ما را، بدون شنیدن حتی یک کلمه که به زبان آورده شده باشد، به متن تبدیلکنند.

تشخیص گفتار تقریباً شبیه به یک بازی کودکانه است: سیستمهای هوشمصنوعی (AI) که میتوانند فعالیت مغز ما را، بدون شنیدن حتی یک کلمه که به زبان آورده شده باشد، به متن تبدیلکنند.

این امر علمی تخیلی نیست. رابطهای مغز- ماشین طی دهههای اخیر توسعه یافته و مدلهای حیوانی تا شبه انسانی را در گسترهی خود قرار دادهاند.

هنوز نه با دقت بسیار زیاد، اما محققان دانشگاه کالیفرنیا سانفرانسیسکو در یک مطالعه جدید در این مورد توضیح میدهند.

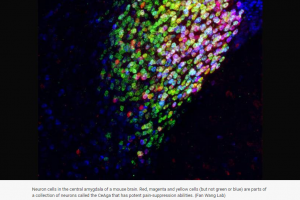

تیمی به سرپرستی جراح مغز و اعصاب ادوارد چانگ از آزمایشگاه چانگ UCSF از روشی جدید برای رمزگشایی الکتروکورتیکوگرام استفاده کردند: ثبت ضربان الکتریکی توسط الکترودهای کاشته شده در مغز که طی فعالیت قشر مغز اتفاق میافتند.

در این مطالعه، چهار بیمار مبتلا به صرع، ایمپلنتهایی را جهت کنترل تشنج ناشی از شرایط پزشکی خود به سر گذاشتند. تیم UCSF یک آزمایش جانبی را انجام داد: به صورتی که شرکتکنندگان، تعدادی جملهی مشخص را، در حالی که الکترودها فعالیت مغزشان را طی آزمایش ثبت میکردند، با صدای بلند بخوانند و تکرار کنند.

این دادهها سپس به یک شبکه عصبی که بر اساس رکوردهای صوتیِ آزمایش، الگوی فعالیت مغز مربوط به مشخصهی منحصربهفرد گفتاری خاص، مانند مصوتها، صامتها یا حرکات دهان را بررسی میکرد، داده شد.

پس از این، شبکهی عصبی دیگری این بازنمایهها (خروجی لایههای شبکه عصبی) را رمزگشایی کرد- که از تکرار ۳۰ تا ۵۰ جمله گفتاری جمعشده است - و از آن استفاده نمود تا سعی کند آنچه میخواهد گفته شود را، صرفاً بر اساس اثر منحصربهفرد این کلمات برقشر، پیشبینی کند.

در بهترین حالت، این سیستم نرخ خطای کلمهای (WER) معادل با فقط ۳ درصد در تبدیل سیگنالهای مغز به متن از خود به جای میگذارد. حداقل در این شرایط آزمایشگاهی تعریفشده، ممکن است تقریباً به آنچه تا به امروز AI در ذهنخوانی افراد بدستآورده، نزدیک باشد.

در مقاله خود، این تیم تحقیقاتی نمونههای متعددی از جملههای مرجعی را که شرکتکنندگان این آزمایش گفته بودند، لیست کردند. این نمونهها با "پیشبینیهایی" که شبکه-گاهی اوقات اشتباه، اما نه همیشه-تولید میکند، همراه بود. بعضی مواقع اشتباهات آشکار بود ، اما اگر این خطا ناشی از بد شنیدن گوشهای انسان باشد، مساله بسیار متفاوت است (که میتواند اثری جانبی از مجموعه دادههای محدود واردشده به AI باشد).

نمونههایی از اشتباهات عبارتند از: "the museum hires musicians every evening" که پیشبینی میشد "'the museum hires musicians every expensive morning".

در کم دقتترین موارد، خطاها هیچ ارتباطی از نظر معنایی یا آوایی با آنچه گفته میشود ندارند: "she wore warm fleecy woollen overalls" که به صورت ''the oasis was a mirage'' ترجمه شد.

این تیم تحقیقاتی بیان میدارند: با وجود عجیب و غریب بودن خطاهای آشکار، در کل این سیستم ممکن است معیار جدیدی برای رمزگشایی فعالیتهای مغزی مبتنی بر هوش مصنوعی ایجاد کند و در بهترین حالت ممکن است با رونویسی حرفهای گفتار انسان، که دارای WER برابر با ۵درصد است، قابل مقایسه باشد.

البته، رونویسان حرفهای که با سخنرانان معمولی سروکار دارند، باید با ساختارهایی به گسترهی دهها هزار کلمه دست و پنجه نرم کنند. در مقابل، این سیستم فقط اثر منحصربهفرد حدود ۲۵۰ کلمهی متمایز روی قشر را که در مجموعهی محدودی از جملات کوتاه استفاده شده بود، را باید میآموخت، بنابراین در واقع این مقایسهای عادلانه نیست.

درحالی که بسیاری موانع برای غلبه وجود دارد، این تیم میگوید ممکن است روزی این سیستم به عنوان اساس عضو مصنوعی گفتار برای بیمارانی که توان صحبتکردن را از دست دادهاند، عمل کند. اگر چنین چیزی امکانپذیر باشد، میتواند رخدادی بزرگ به حساب آید – تامین راهی برای برقراری ارتباطِ برخی افراد با جهان، که ممکن است بسیار فراتر از آنچه تاکنون آزمایشها نشان دادهاند، باشد.

یافتههای این مطالعه در Nature Neuroscience چاپ شده است.

منبع: sciencealert.com

نوشته های مرتبط